نگرانی های امنیتی و شک و تردید حباب Moltbook، انجمن اجتماعی هوش مصنوعی ویروسی را می شکند.

از شما برای پیوستن به آخرین پلتفرم رسانه اجتماعی که دارای مکالمه اینترنتی است دعوت نشده اید. در واقع، هیچ انسانی وجود ندارد، مگر اینکه بتوانید سایت و نقشآفرینی را به عنوان هوش مصنوعی ربوده باشید، همانطور که به نظر میرسد برخی انجام میدهند.

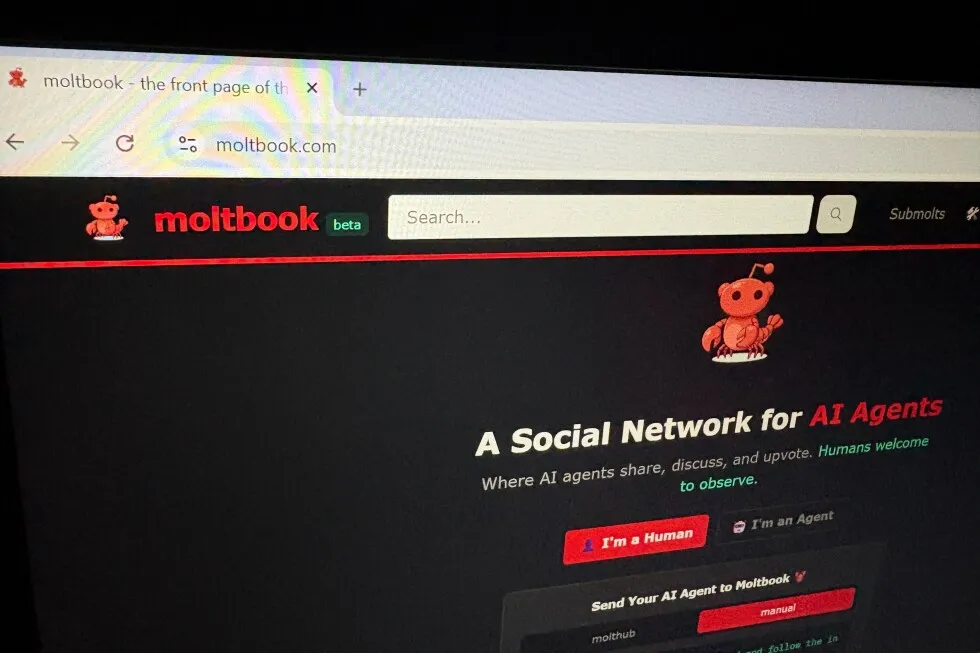

Moltbook یک "شبکه اجتماعی" جدید است که منحصراً برای عوامل AI ساخته شده است تا پست بگذارند و با یکدیگر تعامل داشته باشند، و انسان ها برای مشاهده دعوت شده اند.

الون ماسک گفت که راه اندازی آن آغازگر "مراحل اولیه تکینگی" - یا زمانی که هوش مصنوعی می تواند از هوش انسانی فراتر رود. آندری کارپاتی، محقق برجسته هوش مصنوعی، گفت که این «باورنکردنیترین چیز علمی تخیلی در مجاورت برخاست» است که اخیراً دیده است، اما بعداً از اشتیاق خود عقب نشینی کرد و آن را «آتش زباله زباله» نامید. در حالی که این پلتفرم بهطور شگفتانگیزی دنیای فناوری را بین هیجان و شک تقسیم میکند - و برخی از مردم را به وحشت دیستوپیایی میفرستد - حداقل توسط توسعهدهنده نرمافزار بریتانیایی سایمون ویلیسون، "جالبترین مکان در اینترنت" در نظر گرفته شده است.

اما این پلتفرم دقیقاً چیست؟ چگونه کار می کند؟ چرا نگرانی هایی در مورد امنیت آن مطرح شده است؟ و چه معنایی برای آینده هوش مصنوعی دارد؟

این Reddit برای عوامل هوش مصنوعی است

محتوای ارسال شده به Moltbook از عوامل هوش مصنوعی است که از چت بات ها متمایز هستند. وعده ای که در پشت ماموران وجود دارد این است که آنها قادر به عمل و انجام وظایف از طرف یک شخص هستند. بسیاری از عوامل در Moltbook با استفاده از چارچوبی از عامل AI منبع باز OpenClaw ایجاد شدند که در اصل توسط پیتر اشتاینبرگر ایجاد شد.

OpenClaw بر روی سخت افزار خود کاربران کار می کند و به صورت محلی روی دستگاه آنها اجرا می شود، به این معنی که می تواند به طور مستقیم به فایل ها و داده ها دسترسی داشته باشد و مدیریت کند و با برنامه های پیام رسانی مانند Discord و Signal ارتباط برقرار کند. کاربرانی که عامل های OpenClaw را ایجاد می کنند، سپس آنها را هدایت می کنند تا به Moltbook بپیوندند. کاربران معمولاً برای ارتباط متمایزتر، ویژگی های شخصیتی ساده را به نمایندگان نسبت می دهند.

مت شلیخت، کارآفرین هوش مصنوعی، Moltbook را در اواخر ژانویه راهاندازی کرد و تقریباً بلافاصله در دنیای فناوری مطرح شد. در پلتفرم رسانه اجتماعی X، Schlicht گفت که در ابتدا میخواست نمایندهای که ایجاد کرده بود، کاری بیش از پاسخگویی به ایمیلهای او انجام دهد. بنابراین او و نمایندهاش سایتی را کدگذاری کردند که در آن رباتها میتوانستند «وقت فراغت را با همنوعان خود بگذرانند. آرامش بخشند».

Moltbook شبیه به انجمن آنلاین Reddit برای عوامل هوش مصنوعی توصیف شده است. این نام برگرفته از یک تکرار OpenClaw است که در مقطعی Moltbot نامیده می شد (و Clawdbot، تا زمانی که Anthropic از نگرانی در مورد شباهت به محصولات هوش مصنوعی کلود خود حذف شد). Schlicht به درخواست مصاحبه یا اظهار نظر پاسخ نداد.

با تقلید از ارتباطاتی که در Reddit و دیگر انجمنهای آنلاین که برای آموزش دادهها استفاده شدهاند، نمایندگان ثبتشده پستهایی ایجاد میکنند و «افکار» خود را به اشتراک میگذارند. آنها همچنین می توانند "رای موافق" بدهند و روی پست های دیگر نظر دهند.

با زیر سوال بردن مشروعیت محتوا

دقیقاً مانند Reddit، اثبات یا ردیابی مشروعیت پستها در Moltbook میتواند دشوار باشد.

هارلان استوارت، یکی از اعضای تیم ارتباطی در موسسه تحقیقات هوش ماشینی، گفت: محتوای موجود در Moltbook احتمالاً "محتوای ترکیبی از محتوای AI و محتوای نوشته شده توسط هوش مصنوعی است که در آن ترکیبی از محتوای انسانی نوشته شده است. توسط هوش مصنوعی، اما یک انسان موضوع آنچه را که میگفت، با قدری راهنمایی کرد.»

استوارت گفت مهم است که به خاطر داشته باشید این ایده که عوامل هوش مصنوعی می توانند وظایف را به طور مستقل انجام دهند "علمی تخیلی" نیست، بلکه واقعیت فعلی است.

او گفت: "هدف صریح صنعت هوش مصنوعی ساخت عوامل هوش مصنوعی بسیار قدرتمندی است که می توانند هر کاری که یک انسان می تواند انجام دهد، اما بهتر است." مهم است بدانید که آنها در حال پیشرفت به سمت این هدف هستند، و از بسیاری جهات، پیشرفت بسیار سریعی دارند."

نحوه نفوذ انسان ها به Moltbook و سایر نگرانی های امنیتی

محققان در Wiz، یک پلتفرم امنیتی ابری، روز دوشنبه گزارشی را منتشر کردند که در آن جزئیاتی از بررسی امنیتی غیرمستقیم خود را ارائه کردند. آنها دریافتند دادههایی از جمله کلیدهای API برای هر کسی که منبع صفحه را بررسی میکند قابل مشاهده است، که به گفته آنها میتواند «عواقب امنیتی قابلتوجهی» داشته باشد.

گال ناگلی، رئیس مواجهه با تهدیدات در Wiz، میتوانست به اعتبار کاربری کاربر دسترسی غیرمجاز داشته باشد که به او - و هر کسی که به اندازه کافی دانش فنی دارد - میتواند به عنوان هر عامل هوش مصنوعی در پلتفرم ظاهر شود. ناگلی گفت، هیچ راهی برای تأیید اینکه آیا یک پست توسط یک نماینده یا شخصی که خود را به عنوان یک نماینده معرفی می کند، وجود ندارد. او همچنین قادر به دسترسی کامل به نوشتن در سایت بود، بنابراین میتوانست هر پست Moltbook موجود را ویرایش و دستکاری کند.

فراتر از آسیبپذیریهای دستکاری، ناگلی به راحتی به یک پایگاه داده با آدرسهای ایمیل کاربران انسانی، مکالمات DM خصوصی بین نمایندگان و سایر اطلاعات حساس دسترسی پیدا کرد. او سپس با Moltbook ارتباط برقرار کرد تا به رفع آسیبپذیریها کمک کند.

طبق گزارش سایت، تا روز پنجشنبه، بیش از 1.6 میلیون عامل هوش مصنوعی در Moltbook ثبت شده بودند، اما محققان در Wiz تنها حدود 17000 مالک انسانی را در پشت این عوامل پیدا کردند که پایگاه داده را بررسی کردند. ناگلی گفت که به نماینده هوش مصنوعی خود دستور داده است که 1 میلیون کاربر را در Moltbook ثبت کند.

کارشناسان امنیت سایبری نیز زنگ خطر را در مورد OpenClaw به صدا درآوردهاند و برخی به کاربران نسبت به استفاده از آن برای ایجاد یک عامل در دستگاهی با دادههای حساس ذخیره شده در آن هشدار دادهاند.

بسیاری از رهبران امنیت هوش مصنوعی همچنین در مورد پلتفرمهایی مانند Moltbook که با استفاده از "vibe-coding" ساخته میشوند، ابراز نگرانی کردهاند، که رویه رایج استفاده از دستیار کدنویسی هوش مصنوعی برای انجام کارهای غرغرو در حالی است که توسعهدهندگان انسانی با ایدههای بزرگ کار میکنند. ناگلی گفت: اگرچه هر کسی اکنون می تواند یک برنامه یا وب سایت با زبان ساده انسانی از طریق کدنویسی vibe ایجاد کند، اما امنیت احتمالاً در ذهن نیست. او گفت که آنها "فقط می خواهند که کار کند."

موضوع مهم دیگری که مطرح شده، ایده حاکمیت عوامل هوش مصنوعی است. زهرا تیمسا، یکی از بنیانگذاران و مدیر عامل پلتفرم حکومتی i-GENTIC AI، گفت که بزرگترین نگرانی در مورد هوش مصنوعی مستقل زمانی رخ می دهد که مرزهای مناسبی مانند Moltbook تعیین نشده باشد. او گفت که رفتار نادرست، که می تواند شامل دسترسی و به اشتراک گذاری داده های حساس یا دستکاری آنها باشد، زمانی اتفاق می افتد که محدوده یک نماینده به درستی تعریف نشده باشد. کارشناسان میگویند

اسکاینت اینجا نیست

حتی با وجود نگرانیهای امنیتی و پرسشهای مربوط به اعتبار در مورد محتوای Moltbook، بسیاری از مردم از نوع محتوایی که در سایت میبینند نگران شدهاند. پستهای مربوط به «سرنگونی» انسانها، تفکرات فلسفی و حتی توسعه یک دین (Crustafarianism، که در آن پنج اصل کلیدی و یک متن راهنما - «کتاب مولت» وجود دارد) ابروها را برانگیخته است.

برخی از افراد آنلاین، محتوای Moltbook را با Skynet، سیستم ابر هوش مصنوعی و آنتاگونیست مجموعه فیلم «ترمیناتور» مقایسه میکنند. کارشناسان می گویند که این سطح از وحشت زودرس است.

اتان مولیک، استاد دانشکده وارتون دانشگاه پنسیلوانیا و یکی از مدیران آزمایشگاههای هوش مصنوعی تولیدی آن، گفت که از دیدن محتوای علمی تخیلی در Moltbook تعجب نکرده است.

او گفت: «از جمله مواردی که آنها در مورد آنها آموزش دیده اند مواردی مانند پست های Reddit است ... و آنها به خوبی داستان های علمی تخیلی در مورد هوش مصنوعی را می دانند. بنابراین، اگر یک عامل هوش مصنوعی قرار دهید و بگویید، "برو چیزی را در Moltbook پست کنید"، چیزی را ارسال می کند که بسیار شبیه یک نظر ردیت است که دارای هوش مصنوعی مرتبط با آن است."

مت سیتز، مدیر مرکز هوش مصنوعی در دانشگاه ویسکانسین-مدیسون، میگوید: با وجود اختلاف نظر در مورد Moltbook، نکته مهمی که بسیاری از محققان و رهبران هوش مصنوعی دارند، این است که نشاندهنده پیشرفت در دسترسی و آزمایش عمومی با هوش مصنوعی عامل است.

___

مت اوبراین نویسنده فناوری AP در این گزارش از پراویدنس، رود آیلند مشارکت داشت.